[오토저널] 자율주행자동차를 위한 영상인식기술 동향

페이지 정보

글 : 오토저널(ksae@ksae.org)|

|

승인 2019-01-28 17:29:44 |

본문

영상인식기술이 자율주행자동차에 적용되기 위해서 중요한 2가지가 있다. 바로 속도와 정확도이다. 자율주행자동차에서 영상인식기술이 적용되기 위해서는 우선 실시간(속도)을 보장하여야 한다. 아무리 정확한 알고리즘이라도 오랜 시간이 걸리는 알고리즘이라면 자율주행자동차에서 사용할 수 없다. 예를 들어 알고리즘의 수행 속도가 1초이고, 60km/h의 속도로 주행을 한다면, 알고리즘의 결과는 1초 전의 정보와 약 16.7m 전의 위치에 대한 정보를 가지고 올 것이다. 이는 자율주행자동차에 탑승한 사람뿐만 아니라 주변까지 위험하게 만드는 일이다. 두 번째로 중요한 것은 정확도이다. 매우 빠른 알고리즘이라도 주변의 사물을 제대로 검출하지 못한다면, 위와 마찬가지로 탑승자와 주변까지 위험하게 만들 것이다.

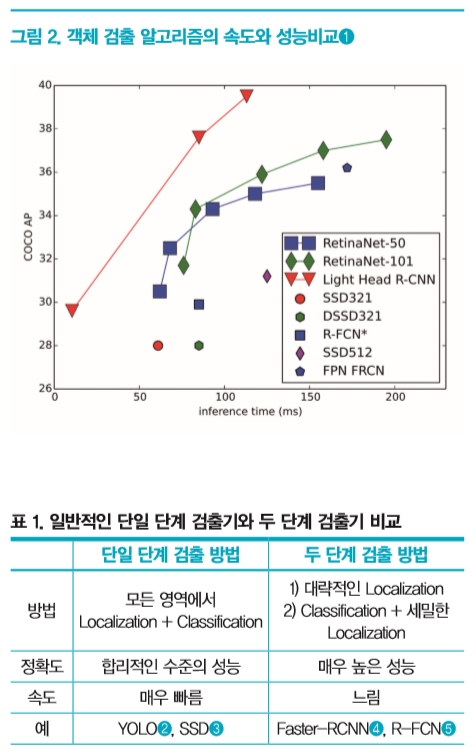

하지만, 여기서 우리는 딜레마에 빠지게 된다. 정확도와 속도 사이에는 Trade-off가 존재하기 때문이다. 알고리즘의 정확도를 향상시키기 위하여 알고리즘을 복잡하게 만들면 속도가 오래 걸리게 되고, 속도를 향상시키기 위해 알고리 즘을 간략화 시키면 성능이 떨어지게 된다. <그림 2>❶는 그 예시를 보여주는 그림이다. <그림 2>의 x축은 수행시간이고, y축은 정확도를 나타내는 방법 중 하나인 mean Average Precision (mAP)이다. 수행시간은 짧을수록 좋으므로, x축에서 왼쪽으로 갈수록 좋고, 성능은 y축에서 위로 갈수록 좋다. 왼쪽 위에 있을수록 속도가 빠르고 정확도가 높은 알고리즘이다. 현재까지도 계속해서 정확도와 성능 향상을 위한 많은 연구개발이 진행 중이다.

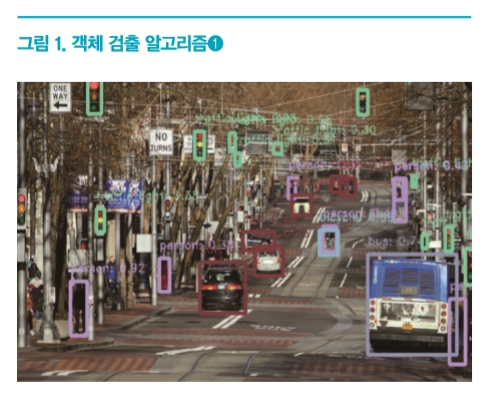

객체 검출 알고리즘은 2가지를 수행해야 된다. 우선 영상에서 객체의 위치를 찾아야하고, 그 위치의 객체가 어떤 물체인지를 분류해야 된다. 즉, Localization과 Classification을 수행하여야 된다. 이를 수행하기 위하여 다양한 방법들이 시도 되었고, 근래에 2가지 방법으로 좁혀졌다.

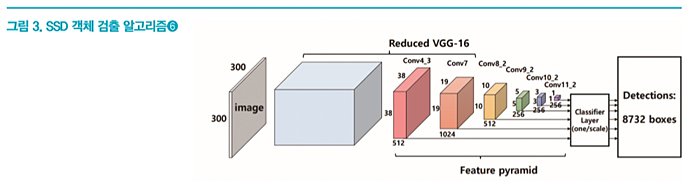

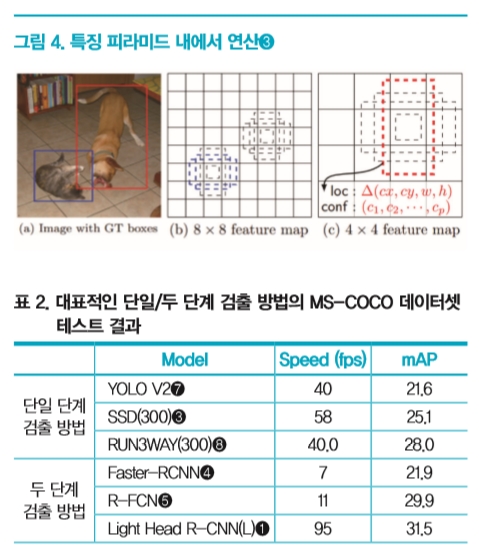

객체 검출 알고리즘은 단일 단계 검출 방법(Single-stage detector)과 두 단계 검출 방법(Two-stage detector)이 있다. <표 1>은 일반적인 단일 단계 검출 방법과 두 단계 검출 방법의 비교를 나타낸 표이다. <표 1>에서 보는 것과 같이, 단일 단계 검출 방법은 모든 영역에 대해서 Localization과 Classification을 동시에 수행한다. 두 단계 검출 방법은 대략적인 Localization을 수행하고, 선출된 후보군들에서 분류와 세밀한 Localization을 수행한다. 일반적으로 단일 단계 검출기가 속도는 더 빠르지만, 정확도는 두 단계 검출기보다 조금 떨어진다. 반대로 두 단계 검출기가 속도는 조금 느리지만, 정확도는 단일 단계 검출기보다 좋다.

단일 단계 검출기(Single-stage detector)

단일 단계 검출기는 앞에서 언급한 것과 같이 모든 영역에서 객체의 위치 검출과 분류를 동시에 수행한다. 이를 동시에 수행하다보니, 속도는 빠르지만, 정확도는 두 단계 검출 방법보다 조금 떨어지는 단점이 존재한다. 대표적인 알고리즘으로 YOLO, SSD 등이 있다. <그림 3>❻은 단일 단계 검출기에서 가장 많이 사용되는 SSD❸의 알고리즘을 나타내는 그림이다. <그림 3>을 살펴보면 처음 RGB 채널의 이미지가 입력으로 들어가게 된다. 이후 Deep Neural Netwrok(DNN) 연산을 수행하여 특징 피라미드(Feature Pyramid)를 만들게 된다. 이 특징 피라미드는 각 객체의 크기에 따른 특징 정보를 가지고 있고, 피라미드에서의 38, 19, 10, 5, 3, 1 의 숫자는 Grid를 나타낸다. 즉 빨간 부분에서는 38×38로 나누어 각 부분에서 객체가 있는지를 살펴보게 된다. 빨간 부분은 이미지 내에서 작은 객체에 대한 정보를 가지고 있고, 보라색 부분은 이미지 내에서 가장 큰 객체에 대한 정보를 가지고 있다.

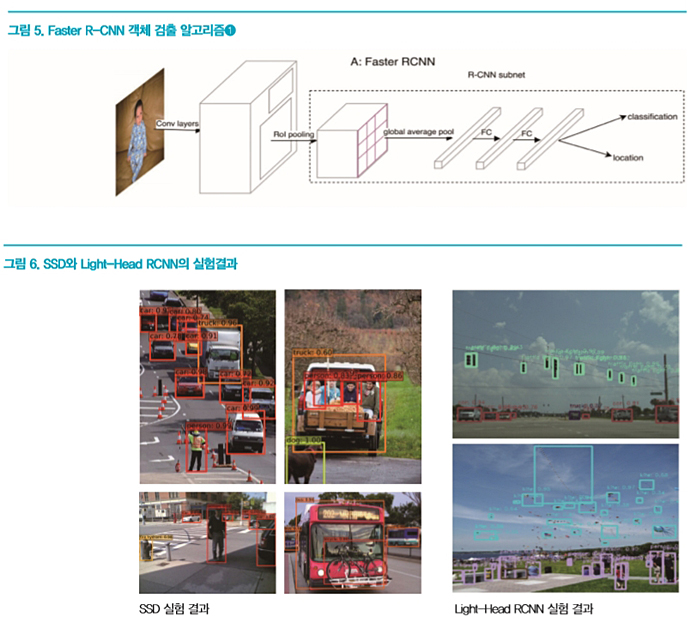

<그림 4>❸는 특징 피라미드에서 객체의 위치검출과 분류를 하는 방법에 대해서 나타내었다. 모든 영역의 특징 피라미드 내에서 다양한 비율의 객체에 대해서 Localization을 수행하고, 모든 객체의 종류에 따른 분류를 수행한다. 이 알고리즘의 결과는 <표 2>에서 확인할 수 있다. 이 알고리즘은 GPU가 포함된 PC환경에서 58Frame per second(fps)의 속도와 25.1의 mAP를 가진다. (위의 실험 데이터가 매우 어려운 데이터 셋이며, <그림 6>❶, ❸에서 보는 것과 같이 결과 이미지들을 보면 매우 좋은 성능을 보임) 이후 YOLO 또는 SSD와 같은 단일 단계 검출 방법의 성능을 향상시키는 다양한 연구들❻, ❽이 진행되었고, 현재도 계속 진행 중이다.

두 단계 검출기(Two-stage detector)

두 단계 검출기는 대략적인 객체의 위치를 검출한 후, 검출된 후보군의 분류와 세밀한 객체의 위치 검출을 수행한다. 대표적인 알고리즘으로 Faster- RCNN, Light-Header R-CNN 등이 있다. <그림 5>❶는 두 단계 검출기에서 가장 많이 사용되는 Faster R-CNN의 알고리즘을 나타내는 그림이다. 그림을 살펴보면 처음 RGB 채널의 이미지가 들어가게 되고, DNN 연산을 수행하여 객체가 있을 만한 위치에 대한 후보군(Region of Interest)들을 찾아낸다(대략적인 Localization). 이후, 후보군들 각각에 대하여 Classification을 수행하고, 후보군 내에서 더욱 정확한 위치에 대한 연산을 수행한다.

두 단계 검출기는 최근까지도 성능은 뛰어나지만 속도가 오래 걸린다는 단점을 가지고 있었다. <표 2>를 살펴보면, Faster-RCNN 또는 R-FCN의 경우 15fps도 되지 않는 것을 볼 수 있다. 하지만, 최근 발표된 Light Head R-CNN이라는 논문❶은 최근 매우 뛰어난 정확도와 속도를 나타냄을 보여주었다. 현재까지 나온 객체 검출 알고리즘도 매우 성능이 좋고 빠른 알고리즘이 많지만, 현실에 적용하기 위해서는 아직 부족한 부분이 많다. 정확도 측면에서 살펴본다면, 정확도를 나타내는 mAP의 최고 값은 1이다. 하지만, 현재 MS-COCO 데이터 셋에서의 mAP는 20~30 정도 수준으로 더욱 높은 성능을 요구한다. 속도적인 측면에서 살펴보면, GPU가 포함된 PC 환경에서의 속도가 100fps이나 실제 임베디드에 적용하기 위해서는 더욱 빠른 알고리즘을 필요로 한다. 아직까지도 객체 검출 알고리즘을 실제로 적용하기 위해서는 많은 기술 연구 및 개발을 필요로 하고, 계속 연구들이 진행되고 있다.

참고자료

❶ Z. Li, et al, Light-Head R-CNN: In Defense of Two-Stage Object Detector, arXiv preprint arXiv:1711.07264, 2017.

❷ J. Redmon, et al, You only look once: Unified, real-time object detection, Proceedings of the IEEE conference on computer vision and pattern recognition. 2016.

❸ W. Liu, et al, Ssd: Single shot multibox detector, European conference on computer vision. Springer, Cham, 2016.

❹ S. Ren, et al, Faster r-cnn: Towards real-time object detection with region proposal networks, Advances in neural information processing systems. 2015. ❺ J. Dai, et al, R-fcn: Object detection via region-based fully convolutional networks, Advances in neural information processing systems. 2016.

❻ J. S. Jeong, H. J. Park and N. J. Kwak, Enhancement of SSD by concatenating feature maps for object detection, The British Machine Vision Conference (BMVC2017), London, UK, Sep. 2017.

❼ J. Redmon, and F. Ali, YOLO9000: better, faster, stronger, arXiv preprint, 2017.

❽ K. M. Lee et al, Residual features and unified prediction network for single stage detection, arXiv preprint arXiv:1707.05031, 2017.

글 / 곽노준 (서울대학교)

출처 / 오토저널 2018년 6월호 (http://www.ksae.org)