[오토저널] 자율주행 자동차 고도화를 위한 인공지능 기술

페이지 정보

글 : 오토저널(ksae@ksae.org)|

|

승인 2019-07-01 09:34:51 |

본문

최근 발생한 우버의 자율주행 자동차의 보행자 사망 사고에 도 불구하고 자율주행자동차가 4차 산업의 핵심기술 중 하 나로 미래의 자동차 산업을 혁신적으로 변화시킬 것임은 부 인할 수 없다. 본 고에서는 완전자율주행의 인식, 공간탐지, 제어 등의 핵심 기능을 구현하기 위해 필수적으로 요구되는 다양한 인공지능 기술의 개발동향을 기술한다.

NHTSA의 2015년 조사 통계에 따르면 인간의 조작오류에 의해 발생되는 차량사고가 94%에 육박하는 것으로 보고되고 있다. 이로 인해 WHO의 2013년 통계에 따르면 125만명이 교통사고로 인해 목숨을 잃은 것으로 조사되고 있는데, 미국의 경우 35,000건 이상의 사망사고가 발행하고 있으며, 이중 캘리포니아에서는 2017년 3,500명 이상의 사망자가 교통사고로 인해 발생되고 있다.

또한 세계 은행에 따르면 Traffic Congestion에 따른 비용은 연간 GDP의 0.5~3%에 육박하고 전체 경제 성장률의 최대 5%까지 육박하며 이로인해 전 세계적으로 약 매년 $1.4 trillion의 비용이 소모되는 것으로 조사된다고 발표한 바 있다. AEB 등 다양한 형태의 ADAS(Advanced Driver Assistant System)이 상용화 되어 이전 대비 지속적인 교통사고에 의한 사회적 비용의 감소가 증대될 것으로 예상되고 있다.

특히 AEB(Autonomous Emergency Braking) 등 IT기술에 기반하여 전방의 객체를 검지한 후 제동을 수행하는 시스템 기술은 사람의 반응 속도인 평균 2.0초 대비 0.3초에 불과해 보다 매우 빠른 제동 동작 수행이 가능하여 효과적인 사고 방지가 가능하다.

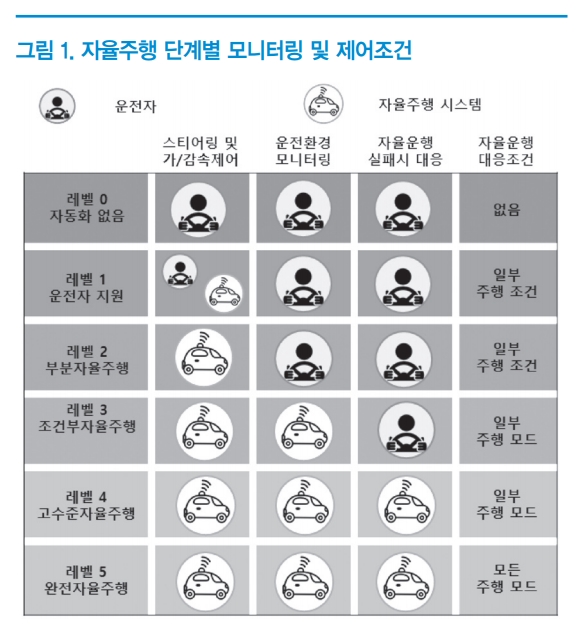

무인 자동차는 기존의 AEB등 ADAS시스템 대비 보행자 사고에 따른 사망을 최대 90%까지 줄일 수 있으며 미국에서만 1,900억 달러를 절감할 수 있을 것으로 예상될 뿐 아니라 대기중으로의 오염물질 배출 감소 등 다양한 분야에서 사회적 비용 감소에 기여할 수 있을 것으로 예상된다. NHTSA에서 정의한 자율주행 자동차의 레벨은 레벨 0부터 레벨 4까지의 5단계로 구분되며 SAE(Society of Automotive Engineers)는 Level 4단계의 완전자율주행을 High Automation(Level 4)과 Full Automation(Level 5)의 2단계로 구분하여 총 6단계로 구분하고 있다. 이중 레벨 0~1은 경고 및 단순 종방향 제어를 포함하는 ADAS 수준이고, 레벨 2이상은 낮은 수준의 자율주행으로 차선유지 등 횡방향 제어 기능이 포함되며 레벨 3 이상은 제한적 상황에서 보다 고도화된 제한적 자율 주행이 구현되며, 레벨 4 이상은 통상 완전한 자율주행을 의미한다.

현재 개발되고 있는 자율주행 차량은 대부분 Level 3 이내의 기술을 적용되어 있으나, Level 4 이상의 자율주행 기술이 차량에 적용되는 경우 자율주행 차량은 매우 복잡한 환경에서 최대한 사고 없이 자율주행을 수행할 것을 요구받게 된다.

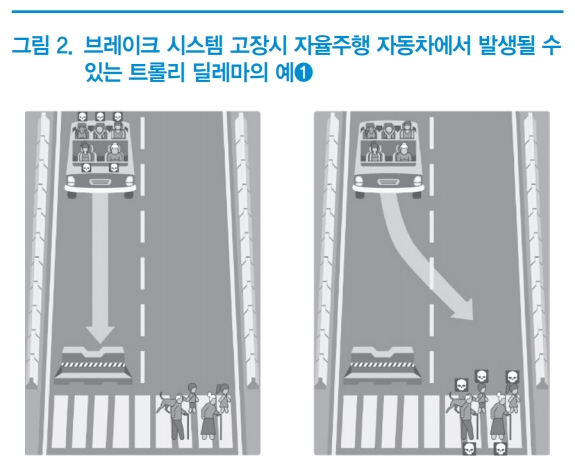

이에 따라 최근 캘리포니아 차량관리국이 발표한 미국 캘리포니아 지역 자율주행 자동차 사고를 분석해 보면, 자율주행차량의 테스트 대수가 늘어나고, 보다 복잡한 도심환경에서 다양한 테스트가 지속적으로 진행됨에 따라 사고율이 급속도로 증가함을 알 수 있는데 이는 본격적인 완전 자율주행 환경에서는 트롤리 딜레마(Trolly Dilemma)와 같은 극단적 선택 상황에서도 시스템이 정해진 규약에 따라 최선의 윤리적인 결정을 수행해야 한다는 것을 의미하며, 이러한 문제를 해결하기 위해서는 기존 ADAS시스템에 적용되어온 주요 도로객체 기준 인식 및 거리탐지 기술 대비 고도의 정밀 객체 및 환경인식(Object Classification & Scene Understanding)과

경로제어(Maneuvering or Path Planning)기술이 요구됨을 의미한다.

최근 몇 년간 인공신경망 기술에 기반한 딥러닝(Deep Learning) 인공지능 기술이 다양한 분야에서 급속도로 확산 적용되어 왔으며 이는 자동차 분야, 특히 자율주행 분야에 있어서도 획기적인 기술적 진보의 가능성을 제시하고 있다. 기존 ADAS시스템에 주로 적용되어온 머신러닝 기반의 분류기법이 주로 특징 기반의 바이너리 인식기(Feature based Binary Classifier)를 기반으로 차량, 보행자, 이륜차 등 제한적인 도로 객체에 대해 인식기를 반복적으로 사용하는 멀티클래스 인식(Multi-class Classification) 방법을 사용함으로써 다중인식 객체 개수의 한계, 모호영역(Ambiguity Region)의 확대에 따른 인식률 저하 등에 매우 취약했던 데 반해, 딥러닝 기반의 인공지능 기법은 최종 출력단의 개수와 이에 따른 네트워크 연결을 조정하는 것으로 보다 다양한 도로객체에 대해 상대적으로 높은 수준의 인식률을 제공한다.

2014년 발표된 R-CNN은 VOC2010 벤치마크의 20종 객체에 대해 기존 가장 높은 인식률을 보인 DPM(Deformable Part Model) 기반 기법 대비 평균 20% 이상의 향상된 성능을 제공한다.

이러한 CNN(Convolutional Neural Network)기반의 딥러닝 알고리즘은 높은 컨벌루션 레이어의 연산량과 더불어 하나의 이미지 프레임 내에서 객체 검지를 위해 로컬라이제이션(Localization)을 수행하여야 하므로 매우 높은 컴퓨팅 파워를 요구하였으나 최근 선택적 탐지(Selective Search), 소프트맥스 분류기 및 바운딩박스 리그레서(Bounding Box Regressor)에 의해 Softmax 앵커(Anchor) 기반의 후보 탐지 기법 또는 신뢰도(Confidence Score) 예측에 따른 후보군 제한기법 등을 적용하고 있다.

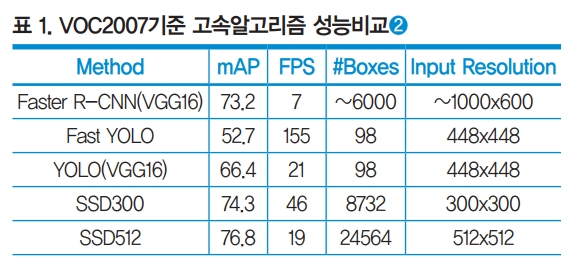

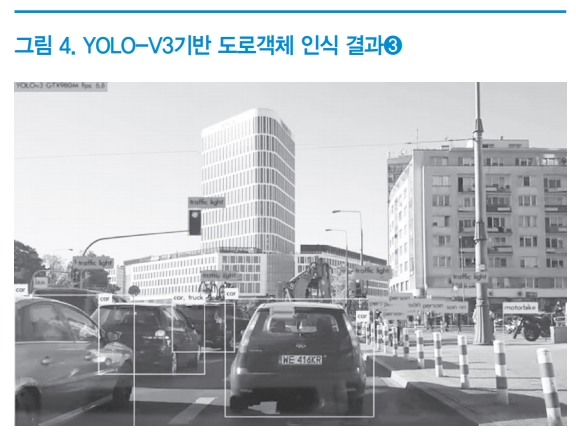

이에 따라 최근 제안되었던 SSD(Single Shot multibox Detector), YOLO(You Only Look Once)등의 실시간 지향형 알고리즘들은 다음의 <표 1> 및 <그림 4>와 같이 높은 인식률을 유지하면서도 매우 빠른 속도로 입력이미지에 대한 객체 검지가 가능하도록 개선되었다.

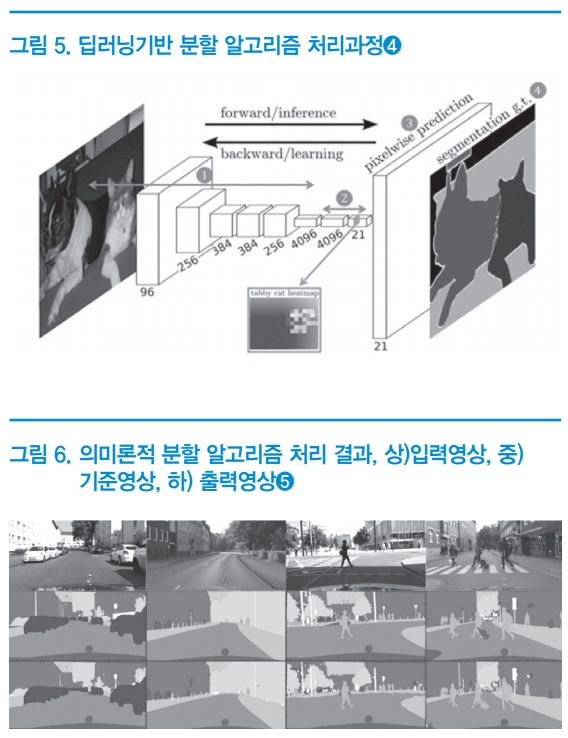

자율주행 차량이 주변 상황을 종합적으로 판단하여 이에 따라 정지 또는 회피 방법 및 경로를 선택하기 위해서는 전술한 박스 기반의 객체인식 알고리즘과 더불어 주행 중 이미지를 통해 도로, 인도, 건물, 수목 등 주변에 대한 이해(Scene Understanding)가 요구된다. 이러한 기법은 의미론적 분할(Semantic Segmentation)이라는 명칭으로 통칭되어 연구되어 왔으며 최근 딥러닝 기술을 기반으로 한 FCN(Fully Convolution Layer)기술이 개발됨으로써 정밀한 픽셀 기반의 주행환경 인식이 가능하게 되었다.

의미론적 분할 과정은 다음의 <그림 5>와 같이 다단계의 2차원 컨벌루션을 수행하여 영상의 의미 정보와 위치 정보를 축약하여 추출한 후 각 클래스를 디컨벌루션을 통해 업샘플링을 하여 원래의 이미지 크기로 키움으로써 <그림 6>과 같이 최종 의미론적 분할이 수행된 이미지를 출력하도록 구성되어 있다.

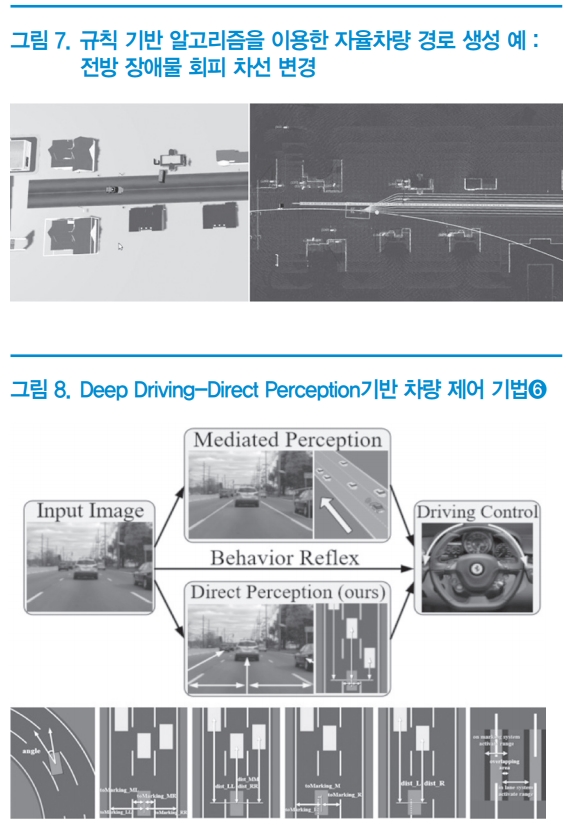

자율주행 차량의 경로제어는 기존 규칙 기반의 로컬 경로제어 방식들이 주로 활용되어 왔으나 주행 환경이 복잡하고, 다양한 도로 객체가 가변적으로 이동과 정지를 수행하는 상황에서는 짧은 시간 내에 가변되는 다양하고 복잡한 규칙이 요구되어 실시간으로 안정적인 도로상의 차선 유지, 변경 등 경로제어가 어려운 문제점이 존재한다.

이러한 문제점을 해결하기 위해 nVIDIA는 입력된 영상을 이용하여 직접 자율주행 제어를 수행하는 End-to-end 기반 자율주행을 CES에서 선보인 바 있으나 이는 단지 학습된 차선을 기준으로 한 차선 유지 기능 지원만이 가능한 문제가 존재한다.

이에, 프린스턴 대학의 Chen 등은 보다 복잡한 실 도로 환경에서 자율주행 차량 주변을 이동하는 차량의 속도 등 다양한 변수와, 차선 등의 정보를 이용하여 차선유지, 변경 및 정지, 가속 등의 제어 동작이 가능한 Deep Driving 방법을 제시하여 이를 TORSC 게임 시뮬레이터 상에서 학습한 후, 이를 기반으로 실 도로에서의 차량의 주행 제어가 적절히 수행됨을 보인바 있다.

그러나 이들 알고리즘은 다양한 차량 동역학 모델 및 경로조건 등의 정보가 반영되지 않아 보다 복잡한 환경에서 정밀한 차량제어가 어려운 문제가 존재하므로 이러한 문제를 해결하기 위해 강화학습 기반의 딥러닝 방법이 많이 연구되고 있다.

완전 자율주행을 구현하기 위해서는 주행조건, 차량상태 등에 대한 고려 뿐 아니라 법, 규정 및 윤리적인 측면에 따른 대응 방안 등 다양하고 복잡한 조건에 대해 대응가능한 새로운 기술 개발이 요구된다. 본 고에서는 이러한 문제들을 해결하기 위해 기존 기계학습(Machine Learning) 및 규칙 기반(Rule Based)인식 및 차량 제어방법 대비 각광받고 있는 기술인 딥러닝 기반의 도로 객체 인식기법과 의미론적 분할기법의 동작원리와 연구동향을 간략히 살펴보았으며 또한 이러한 환경인식 정보를 바탕으로 하 여 자율주행 차량을 복잡한 환경에서도 안정적으로 제어하여 최종 목적지까지 이동하기 위한 딥러닝 기반의 제어 기법의 연구 동향을 살펴보았다.

글 / 민경원 (전자부품연구원)

출처 / 오토저널 2018년 8월호 (http://www.ksae.org)