[오토저널] 일본의 3차원 객체 감지 기술 동향

페이지 정보

글 : 오토저널(ksae@ksae.org)|

|

승인 2020-08-27 10:59:56 |

본문

일본은 고령화와 일손 부족 문제로 인해 자율주행 기술에 대한 기대감이 커져 최근 몇 년 동안 자율주행차 실증 사업을 적극적으로 추진하고 있다. 그 중 일본의 자율주행 소프트웨어 업체인 TIER IV는 로봇택시 자율주행 실증을 수행하는 등 관련 경험을 축적하고 있다. 본 고에서는 TIER IV의 딥러닝을 이용한 최근 3차원 객체 감지 방법에 대해 살펴보고 기존 방식과의 차이점에 대해 살펴보기로 한다.

●딥러닝 베이스 점군처리

●점군을 처리하기 위한 딥러닝

자율주행 분야에서는 주로 주위 환경을 인식할 때 딥러닝을 이용하는 경우가 많고 관련해서 화상 인식 알고리즘인 SSD, YOLO가 잘 알려져 있다. 딥러닝은 자율주행에서 객체 감지 외에, 판단 및 차량 제어에도 응용되고 있다. 그 가운데 이번에는 고정밀 객체 검출과 형상추정을 위해 딥러닝을 점군 처리에 응용한 알고리즘에 대해 알아보기로 한다.

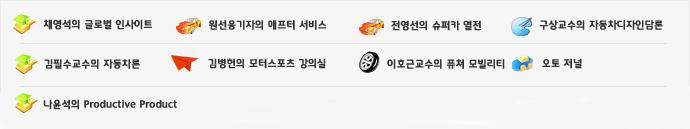

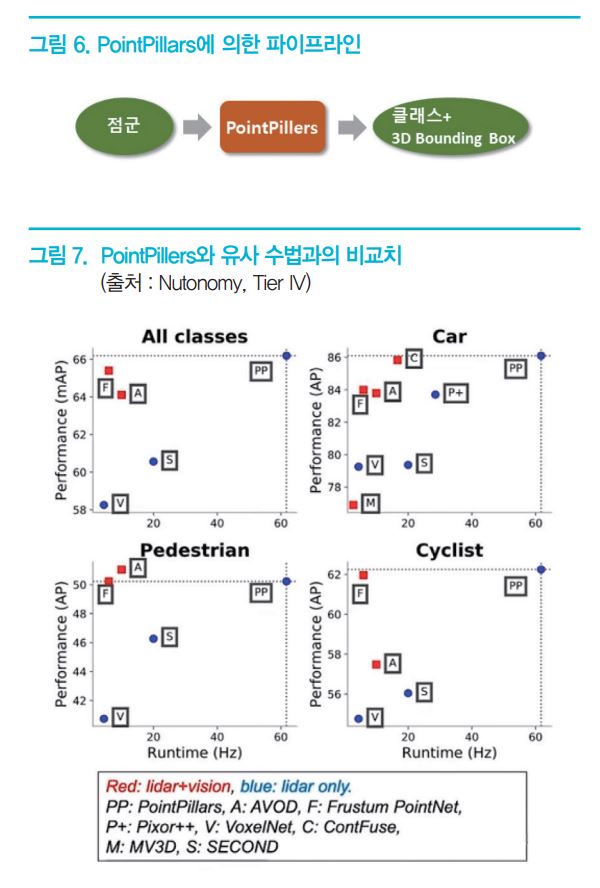

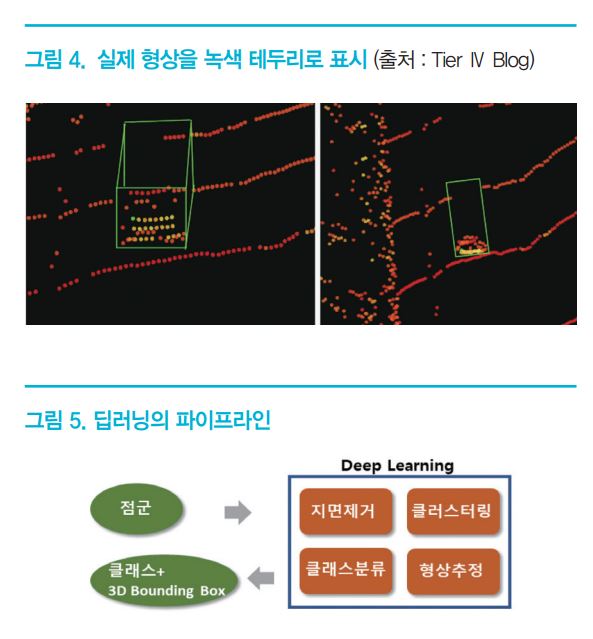

●기존의 방법

기존의 방법은 <그림 1>처럼 점군에 대해 순서대로 다양한 처리를 해나가는 파이프라인으로 되어 있는데 자율주행 분야에서 요구되는 고정밀 검출이 어렵다는 문제가 있다. <그림 2>의 우측의 이미지는 클러스터링 수법의 하나인 Euclidean Cluster의 결과를 표시하고 있다. 전방 왼쪽에 오토바이, 전방 오른쪽에 자동차가 있는 상황이지만 두 객체를 하나의 객체로 감지하고 있어(같은 핑크색으로 감지) 각각의 객체를 구분하지 못하고 있다.

●형상 추정 필요성

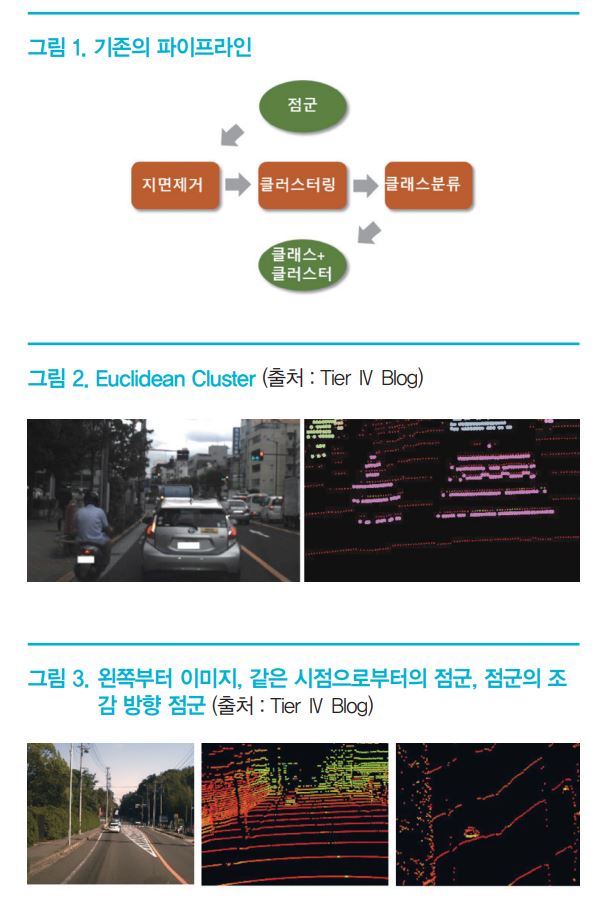

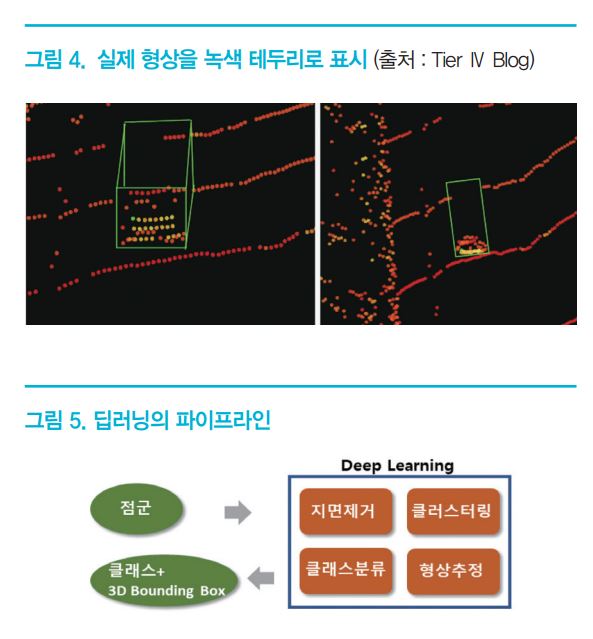

자율주행에 있어서 또다른 객체 감지의 어려움의 하나로써 오클루젼(Occlusion) 문제를 들 수 있다. 기존의 파이프라인으로는 일부 객체 형상만 얻을 수 있는 상황에서 객체 전체의 형상을 추정하기 어려웠다. <그림 3>의 이미지는 전방 차량을 다양하게 본 것이다. 가장 오른쪽 조감 방향의 이미지에서는 전방 차량의 형상을 알기 어렵다. 실제 객체는 <그림 4>와 같이 존재한다고 할 수 있다.

이와 같이 객체 전체의 형상을 추정하는 것은 Tracking이나 Planning 등 자율주행의 중요한 프로세스에서 유용하다고 할 수 있다.

●딥러닝 베이스 점군처리

기존 기법에서는 점군을 순서대로 처리했지만 딥러닝 베이스 기법에서는 End-to-end로 최적화된 등급 분류와 형상 추정을 할 수 있다. 이것은 <그림 5>처럼 기존의 파이프라인에서의 지면제거, 클러스터링, 클래스 분류 처리를 내포하고 있다고 할 수 있다. 또한, 객체의 형상에 대해서도 사전지식을 이용함으로써 기존 기법으로 할 수 없었던 전체 형상의 고정밀 추정이 가능하게 되었다.

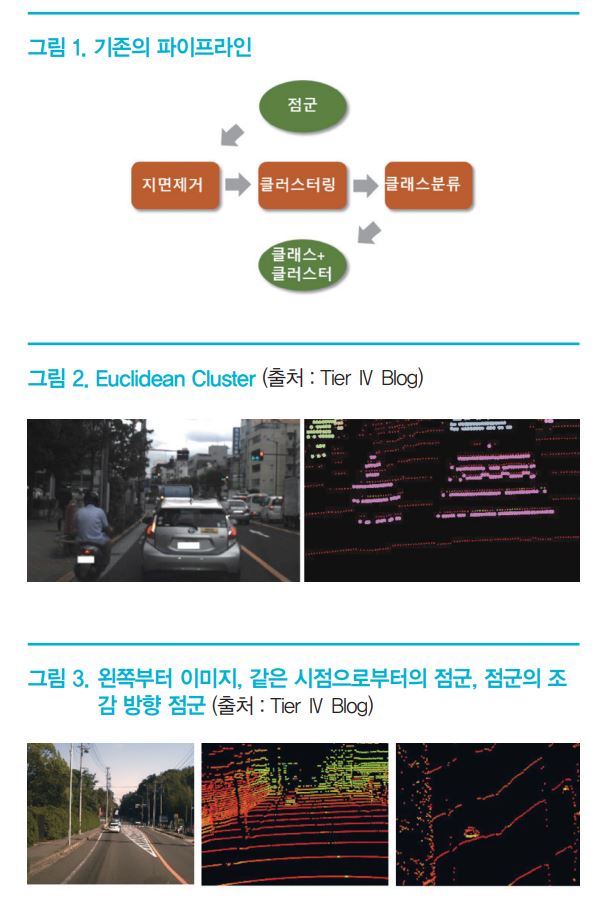

●3차원 객체 감지 알고리즘 PointPillars

기존 기법에서는 어려웠던 고정밀도의 객체 감지와 형상 추정을 위해 Nutonomy에서 ‘PointPillars’라는 알고리즘을 제안했고, TIER IV는 PointPillars 구현 과정에서 알고리즘 효율화를 시도했다.

●유사 수법

2016년에 발표된 MV3D에서는 화상과 점군을 사용하여 Faster R-CNN을 본뜬 구조로 특징 추출 후에 Fusion을 하고 3차원 Bounding Box를 생성했다. 2017년에 Apple의 연구원이 발표한 VoxelNet에서는 PointNet을 바탕으로 한 Point 단위 특징량 추출과 Voxel 단위에서의 부분적인 특징량 계산을 맞춰서 수행하여 MV3D를 넘어서는 성능을 보여주었다. 2018년 발표된 SECOND는 VoxelNet 구조를 참고하여, 일부에 Sparse Convolution을 적용함으로써 모델의 경량화와 성능 향상을 도모했다.

●PointPillars의 유용성

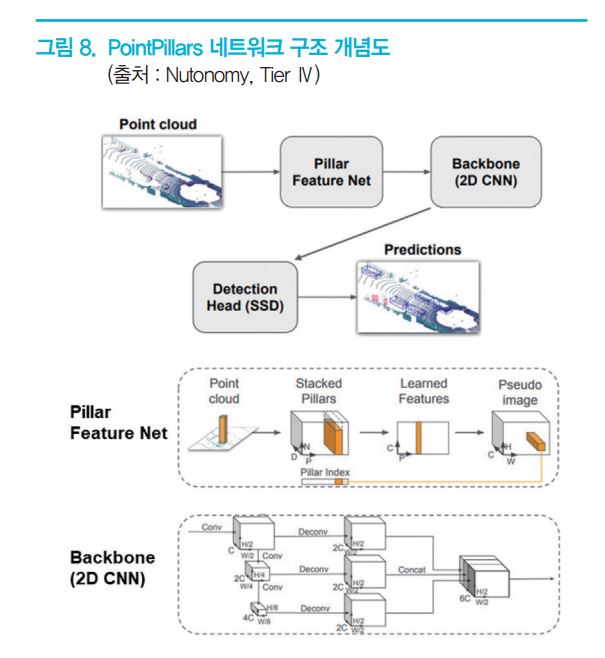

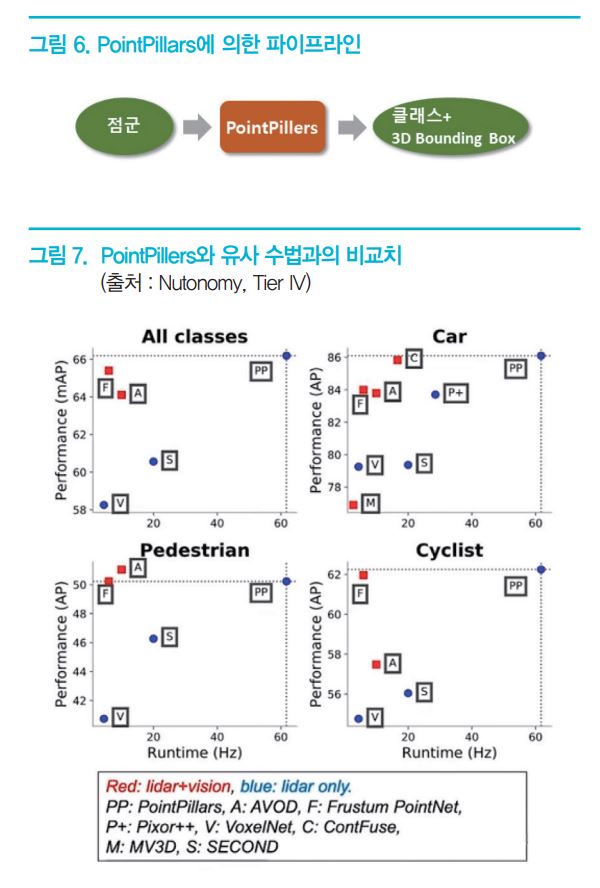

SECOND와 같은 시기에 Nutonomy에서 발표된 것이 PointPillars였다. VoxelNet을 답습하면서 Voxel단위 특징 추출이 아닌 Pillar(기둥) 단위에서의 특징 추출과 2D-convolution 사용에 따른 경량화된 구조가 특징이라고 할 수 있다. 많은 알고리즘 중에서 TIER IV가 PointPillars를 선택한 이유는 처리속도와 예측정밀도의 균형이 좋기 때문이다. 예측 정확도는 다른 알고리즘과 비교해서 최고 수준인 동시에 처리 속도가 16ms(약 62Hz)에서 작동하여, 기존 수법과 비교하여 가장 빠르게 동작하는 것으로 알려져 있다. <그림 7>은 클래스별로 비교 항목 중 PP(PointPillars)가 다른 알고리즘에 비해서 예측 정밀도와 처리 속도의 두가지 면에서 뛰어나다는 것을 나타내고 있다.

네트워크 구조는 VoxelNet와 비교하여 Pillar단위의 특징 추출과 2D-convolution 사용에 따라 경량화되었다.

●CUDA와 TensorRT에 의한 고속화

기존 수법과 비교한 큰폭의 고속화는 두 가지 요인으로 가능했다. 하나는 네트워크 구조의 슬림화, 그리고 또 하나는 TensorRT라고 하는 딥러닝의 추론을 고속화하는 Library의 사용이다. TensorRT는 편리하지만, 대응하고 있는 레이어의 종류가 한정되어 있다는 단점이 있다. 실제로 PointPillars에서 사용하고자 했던 ‘Scatter’라고 불리는 레이어를 CUDA로 구현하여 메모리 전송에 소요되는 시간을 절감했다.

또한 점군의 전처리와 후처리에서도 CUDA를 이용함으로써, 계산과 메모리 전송 효율화를 도모했다. 딥러닝으로 인한 점군처리 기법의 문제점 중 하나가 처리속도가 느린 것이었다. 예를 들어 유사 수법으로 소개한 VoxelNet에서는 225ms 걸렸고, LIDAR 센서 주기가 그보다 빈번히 움직이고 있음을 감안하면 자율주행에서 다루기는 어려운 알고리즘이라고 할 수 있다. TIER IV의 최신 버전에서 전처리·후처리에 CUDA를 이용함으로써 전체 처리 시간을 12ms까지 단축했고, PointPillars 알고리즘을 자체 개발한 자율주행 소프트웨어인 ‘Autoware’에 적용하여 주행 환경 모사를 수행하고 있다.

센서나 화상인식 기술 고도화로 인해 향후 자율주행차 보급이 활성화된다면 교통사고가 줄어들고, 생활 편의가 보장될 것으로 많은 사람들은 기대하고 있다. 그런데도 여전히 완전 자율주행차 상용화에 제동이 걸리는 것은 인재로 인한 교통사고 피해보다 AI 재해로 인한 피해가 사람들에게 큰 충격을 주기 때문이다.

사람 운전자에게 완벽한 운전을 기대하지는 않지만, 대다수가 AI에 의한 운전에는 완전무결성을 요구한다. 그런 관점에서 자율주행차의 상용화 여부는 사람들이 어디까지 AI에 의한 재해를 수용할 수 있는지 여부에 달려 있다고 사료된다.

글 / 정선호 (지능형자동차부품진흥원)